La gestion efficace des fichiers constitue un enjeu majeur pour tout administrateur système ou développeur opérant sous Linux. La compression de fichiers demeure une pratique incontournable, permettant de réduire l’espace disque, d’accélérer les transferts réseau et de simplifier l’archivage de données volumineuses. Bien que le format ZIP ne soit pas natif à Linux, contrairement aux formats TAR ou GZIP, il représente le standard universel de compression reconnu sur tous les systèmes d’exploitation—Windows, macOS et distributions Linux—ce qui en fait un passage obligé pour tout professionnel de l’informatique.

Préparation de l’environnement et installation des outils essentiels

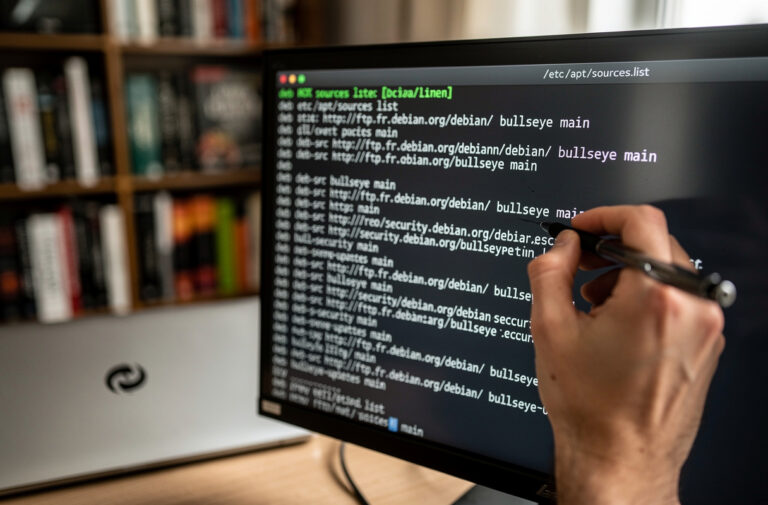

Avant de procéder à la compression ou à la décompression de fichiers ZIP sous Linux, il convient de s’assurer que les outils nécessaires sont correctement installés sur le système. Sur une distribution Debian ou Ubuntu, le gestionnaire de paquets APT offre un accès direct aux applications requises. La plupart des distributions Linux modernes intègrent ces outils par défaut, mais une vérification demeure recommandée pour éviter des blocages lors de la manipulation d’archives.

L’installation des paquets zip et unzip s’effectue en quelques secondes via le terminal. Le paquet zip fournit la commande permettant de créer et de modifier les archives, tandis que unzip gère l’extraction du contenu. Ces deux outils fonctionnent conjointement pour offrir une gestion complète des fichiers compressés au format ZIP. Après installation, le système dispose de l’ensemble des capacités nécessaires pour manipuler archives et répertoires.

La commande suivante procède à la mise à jour du catalogue des paquets, puis à l’installation des deux outils indispensables :

- 🔄 Mettre à jour la liste des paquets disponibles

- 📦 Installer le paquet zip pour la compression

- 📦 Installer le paquet unzip pour la décompression

- ✅ Vérifier l’installation en testant les commandes

Une fois l’installation terminée, les commandes deviennent immédiatement opérationnelles. La vérification peut s’effectuer simplement en affichant le numéro de version de chaque outil, confirmant ainsi leur présence active sur le système.

Vérification de l’installation et premiers tests

La vérification constitue une étape prudente, notamment dans un environnement de production où l’absence d’un outil peut arrêter un processus automatisé. Deux commandes suffisent pour confirmer que les utilitaires fonctionnent correctement. La commande zip -v affiche la version installée et les capacités du programme, tandis que unzip -v procède de manière identique pour l’outil de décompression.

Ces vérifications rapides rassurent quant à la disponibilité des ressources. Au-delà du simple contrôle de version, un test pratique consiste à créer une petite archive et à la décompresser, garantissant la fluidité de l’interaction avec le système de fichiers. Cette approche méthodique prévient les surprises lors de manipulations critiques.

| 🔧 Commande | 📝 Fonction | 💡 Utilité |

|---|---|---|

| zip -v | Affiche la version de zip | Confirmer l’installation |

| unzip -v | Affiche la version d’unzip | Vérifier la décompression |

| which zip | Localise l’exécutable zip | Identifier le chemin système |

| which unzip | Localise l’exécutable unzip | Identifier le chemin système |

Maîtriser la compression de fichiers avec la commande zip

La compression de fichiers constitue l’opération fondamentale dans la gestion d’archives. La commande zip s’avère puissante et flexible, permettant de créer des archives compressées à partir de fichiers individuels, de répertoires entiers ou de sélections spécifiques. Comprendre sa syntaxe et ses options ouvre des perspectives variées selon les besoins opérationnels rencontrés en environnement professionnel.

La structure générale de la commande suit un schéma logique : l’utilisateur spécifie d’abord le nom de l’archive ZIP à créer, puis indique les fichiers ou répertoires à inclure. Des options supplémentaires permettent d’affiner le comportement, comme le niveau de compression, l’exclusion de certains fichiers ou l’ajout d’une protection par mot de passe. La flexibilité de cet outil en fait un allié indispensable pour l’archivage systématique de données.

Créer une archive basique et ajouter des fichiers

L’opération la plus simple consiste à créer une archive contenant un ou plusieurs fichiers. La syntaxe de base ne requiert que deux éléments : le nom de l’archive ZIP souhaitée et la liste des fichiers à compresser. Pour illustrer ce processus, imaginons un scénario courant : un administrateur doit archiver dix documents texte générés par une application.

La création de fichiers de test s’effectue rapidement via la commande touch combinée avec une expansion de plage. Cette approche économise du temps comparé à la création manuelle d’une série de fichiers. Une fois les fichiers en place, la compression regroupe l’intégralité de ces documents dans une archive unique, réduisant significativement l’espace occupé et facilitant le transfert ou la sauvegarde.

L’inspection du contenu de l’archive avant décompression revêt une importance pratique. La commande zip -sf ou l’utilitaire zipinfo affichent la liste détaillée des fichiers stockés dans l’archive, incluant leur taille originale, leur taille compressée et le ratio de compression obtenu. Cette vérification préalable évite les mauvaises surprises lors de la décompression ultérieure.

- 🎯 Créer rapidement plusieurs fichiers de test avec touch document{1..10}.txt

- 📦 Compresser par wildcard : zip archive document*.txt

- 👁️ Lister le contenu : zip -sf archive.zip

- 📊 Afficher les détails : zipinfo archive.zip

- ✨ Vérifier le ratio de compression obtenu

Compresser des répertoires entiers de manière récursive

Au-delà des fichiers individuels, la compression d’un répertoire complet s’avère souvent plus efficace et pratique. La structure arborescente entière—fichiers et sous-répertoires—se retrouve encapsulée dans une seule archive. L’option -r (récursive) indique au programme de descendre dans tous les niveaux de répertoires et de capturer chaque élément rencontré.

Ce comportement récursif s’avère particulièrement utile lors de l’archivage de projets logiciels, de dossiers de documents ou de répertoires de configuration. Un développeur doit-il sauvegarder un dépôt Git complet ? La compression récursive crée une archive portable, facilement transférable vers d’autres systèmes ou stockable sur des supports d’archive longue durée.

Une nuance importante : la commande crée l’archive dans le répertoire courant de l’exécution, pas nécessairement à la racine du répertoire cible. L’utilisateur conserve ainsi un contrôle précis sur le lieu de création de l’archive. La taille de l’archive générée dépend du nombre et du volume des fichiers présents dans le répertoire—un facteur à considérer avant de procéder si l’espace disque disponible demeure limité.

| ⚙️ Option | 📋 Description | 🔌 Cas d’usage typique |

|---|---|---|

| -r | Récursif : inclut tous les sous-répertoires | Archive d’un projet complet |

| -x « pattern » | Exclut les fichiers correspondant au motif | Ignorer fichiers temporaires ou de cache |

| -e | Protège l’archive avec mot de passe | Sécuriser données sensibles |

| -0 à -9 | Définit le niveau de compression (0=aucun, 9=max) | Optimiser vitesse vs taille |

| -u | Met à jour ou ajoute fichiers à archive existante | Incrémenter une archive |

Filtrer les fichiers et appliquer des exclusions intelligentes

Lors de la compression d’un répertoire complexe, certains fichiers méritent d’être exclus de l’archive. Les fichiers temporaires, les caches de compilation, ou les logs volumineux n’apportent aucune valeur dans une archive de sauvegarde ou de transfert, voire augmentent inutilement sa taille. L’option -x permet de préciser les motifs de fichiers à ignorer, utilisant des caractères de remplacement comme l’astérisque (*).

La sélection positive offre l’inverse : ne compresser que certains fichiers correspondant à un type spécifique. Le caractère * agit comme wildcard, remplaçant une série quelconque de caractères. Un exemple concret : un répertoire contient des fichiers texte, des images et des documents Office. La compression exclusive des fichiers *.txt réduit sensiblement la taille finale tout en préservant les documents textuels.

Ces filtres diminuent le temps de traitement et le stockage requis. Une archive minimalisée se transfère plus rapidement sur les réseaux d’entreprise, se sauvegarde plus efficacement et occupe moins d’espace sur les systèmes de backup. La discipline en matière d’inclusion/exclusion reflète une gestion consciente des ressources informatiques.

- 🚫 Exclure tous les fichiers .docx : zip -r archive /path/* -x « *.docx »

- ✋ Exclure un dossier entier : zip -r archive /path/* -x « */cache/* »

- 📄 Inclure uniquement les fichiers .pdf : zip archive *.pdf

- 🔍 Combiner plusieurs exclusions : zip -r archive /path/* -x « *.tmp » -x « *.log »

- 🎯 Utiliser des patterns complexes pour un filtrage affiné

Protéger une archive avec chiffrement et mot de passe

La sécurité des données compressées ne doit jamais être négligée. Par défaut, une archive ZIP ne propose aucune protection : quiconque possédant le fichier peut en visualiser le contenu et extraire les données. Pour des informations sensibles—identifiants, fichiers de configuration, données personnelles—l’ajout d’une protection par mot de passe devient impératif.

L’option -e (encrypt) active le chiffrement interactif : le programme demande deux fois de saisir le mot de passe avant de créer l’archive. Ce mot de passe devient la clé d’accès unique à l’archive. Sans celui-ci, l’extraction échoue, rendant le contenu inaccessible. Le niveau de chiffrement utilisé par ZIP (méthode traditionnelle ou AES) varie selon les besoins de sécurité perçus.

Une mise en garde s’impose : les mots de passe simples ou courts demeurent vulnérables à des attaques par force brute, particulièrement avec les capacités de calcul actuelles. L’utilisation de mots de passe longs, complexes et unique s renforce considérablement la protection. Dans un contexte professionnel, des politiques de mots de passe stricts doivent encadrer cette pratique.

Optimiser la compression en ajustant les niveaux

Le format ZIP supporte neuf niveaux de compression, numérotés de 1 à 9, auxquels s’ajoute le niveau 0 pour un simple stockage sans compression. Ce graduel permet d’ajuster le compromis entre taille finale et temps de traitement. Un niveau faible compresse rapidement mais produit une archive plus volumineuse, tandis qu’un niveau élevé réduit drastiquement la taille au prix d’un temps de traitement accru.

Le choix du niveau dépend du contexte opérationnel. Une compression urgente de fichiers volumineux bénéficie d’un niveau 6 ou 7, offrant un bon équilibre. Une archive destinée au stockage longue durée justifie l’utilisation du niveau 9, même si le traitement initial consomme davantage de ressources. Le niveau 0 s’emploie pour les besoins d’archivage simple sans dégradation du contenu, conservation intégrale mais sans bénéfice de compression.

La sélection du niveau optimal requiert de tester selon les fichiers manipulés. Les fichiers texte, documents Office et code source se compriment excellemment. Les images JPEG ou les vidéos déjà compressées bénéficient peu de la compression supplémentaire. Adapter la stratégie aux caractéristiques des données garantit une utilisation efficiente des ressources.

- ⚡ Niveau 1 : compression rapide, archive volumineuse

- ⚖️ Niveau 6 : équilibre vitesse/taille (défaut)

- 🔨 Niveau 9 : compression maximale, traitement lent

- 💾 Niveau 0 : aucune compression, archivage simple

- 📈 Tester sur fichiers réels pour déterminer le gain obtenu

Maintenir et augmenter une archive existante

Les besoins évoluent : des fichiers supplémentaires doivent s’ajouter à une archive créée antérieurement. Plutôt que de recréer l’archive entière, consommant temps et ressources, l’option -u (update) permet d’incrémenter l’archive existante. Cette approche conserve les fichiers déjà présents et n’ajoute ou remplace que les éléments spécifiés.

Cette fonctionnalité s’avère précieuse dans les stratégies de sauvegarde incrémentale. Un administrateur système peut configurer un script qui, chaque jour, ajoute les fichiers modifiés depuis la dernière exécution à l’archive. Cette approche réduit significativement l’espace disque requis et accélère les processus récurrents, comparé à la création d’une nouvelle archive complète chaque fois.

La mise à jour respecte le contenu existant : un fichier déjà présent dans l’archive sera remplacé si une version plus récente est ajoutée. Les fichiers non mentionnés dans la commande d’update restent inchangés dans l’archive. Cette mécanique offre une flexibilité remarquable pour les workflows opérationnels complexes.

Maîtriser l’extraction avec la commande unzip

L’extraction d’archives ZIP se présente comme l’opération complémentaire de la compression. Si créer une archive requiert une certaine planification, extraire son contenu obéit à des principes simples mais susceptibles de variations selon le contexte. La commande unzip offre une gamme d’options permettant de décompresser sélectivement, de vérifier avant d’extraire, ou de placer les fichiers dans des emplacements définis.

La structure de base demeure épurée : l’utilisateur spécifie l’archive à décompresser, et le programme restitue les fichiers au répertoire courant. Des options supplémentaires permettent de rediriger l’extraction vers un autre répertoire, d’extraire fichier par fichier sélectivement, ou de traiter des archives protégées par mot de passe. Une compréhension approfondie de ces possibilités transforme unzip en outil de gestion précis et fiable.

Extraire une archive dans le répertoire courant

La décompression basique s’effectue sans complication : une seule commande suffit pour restituer l’intégrité du contenu de l’archive. Le programme respecte la structure des répertoires présents dans l’archive, reproduisant l’arborescence dans le répertoire courant d’exécution. Cet automatisme simplifie grandement les workflows, l’utilisateur n’ayant qu’à nommer l’archive source.

Avant de procéder à la décompression proprement dite, une inspection préalable du contenu de l’archive prévient les surprises. La commande unzip -l affiche une liste détaillée incluant la taille originale de chaque fichier, sa taille compressée, le ratio de compression atteint, et naturellement son nom. Cette vérification identifie rapidement les contenus problématiques ou inattendus.

Des informations complémentaires apparaissent dans le rapport : le nombre total de fichiers présents dans l’archive, la taille cumulée originale et celle après compression. Ces métadonnées aident l’administrateur à anticiper l’espace disque requis après décompression ou à identifier des archives anormalement compressées, révélateurs possibles de corruption ou de problèmes lors de la création.

| 📦 Commande | 🎯 Action | 💬 Description |

|---|---|---|

| unzip archive.zip | Décompression standard | Extrait tous les fichiers au répertoire courant |

| unzip -l archive.zip | Liste le contenu | Affiche fichiers, tailles et ratios sans décompression |

| unzip -t archive.zip | Test d’intégrité | Vérifie que l’archive n’est pas corrompue |

| unzip archive.zip -d /path/ | Décompression ciblée | Extrait vers un répertoire spécifique |

| unzip -P motdepasse archive.zip | Décompression protégée | Extrait en fournissant le mot de passe |

Rediriger l’extraction vers un répertoire cible

Dans bon nombre de situations, décompresser l’archive au répertoire courant s’avère impratique ou indésirable. L’option -d (directory) permet de spécifier un chemin d’extraction alternatif. Cette flexibilité se révèle précieuse lorsque plusieurs archives doivent être décompressées dans des emplacements distincts, ou lorsque le répertoire courant manque d’espace disque disponible.

L’utilisation d’un répertoire cible facilite également l’organisation des fichiers restaurés. Un administrateur peut créer une structure arborescente prédéfinie et diriger différentes archives vers les emplacements appropriés, automatisant ainsi l’organisation de données complexes. Cette approche s’inscrit dans les meilleures pratiques de gestion de fichiers en environnement professionnel.

Le répertoire cible doit exister préalablement à la décompression, sinon la commande génère une erreur. Créer le répertoire de destination avant d’exécuter unzip constitue une prudence recommandée, éliminant les sources potentielles d’échec. Une fois le chemin validé, l’extraction procède de manière fluide et prévisible.

- 📂 Créer le répertoire cible : mkdir -p /destination/path

- 📥 Extraire vers ce répertoire : unzip archive.zip -d /destination/path

- 🔗 Utiliser des chemins relatifs ou absolus indifféremment

- ✅ Vérifier les permissions du répertoire cible

- 📊 Monitorrer l’espace disque disponible avant extraction

Gérer les archives protégées par mot de passe

Une archive chiffrée demande explicitement le mot de passe lors de la décompression. Le programme offre deux approches : une demande interactive où l’utilisateur saisit le mot de passe après lancer la commande, ou une transmission directe du mot de passe via l’option -P en ligne de commande. La première méthode renforce la sécurité en évitant l’exposition du mot de passe dans l’historique du shell, tandis que la seconde accélère les traitements automatisés.

Une précaution s’impose : transmettre un mot de passe en ligne de commande le rend visible dans les journaux du système et l’historique du shell. Dans un environnement partagé ou critique, cette pratique comporte des risques de sécurité. Privilégier la saisie interactive demeure préférable pour les données sensibles. Les scripts automatisés peuvent utiliser des fichiers de configuration protégés ou des gestionnaires de secrets pour mitiger ces risques.

L’intégrité de l’archive chiffrée détermine la réussite de la décompression. Une archive corrompue ou altérée génère des erreurs lors de la tentative de décompression, même avec le bon mot de passe. Vérifier régulièrement l’intégrité des archives critiques via unzip -t constitue une bonne pratique pour détecter les dégradations potentielles avant qu’elles ne causent des problèmes.

Extraire sélectivement des fichiers individuels

La décompression complète n’est pas toujours nécessaire. Extraire un seul fichier d’une archive volumineuse économise espace disque et temps de traitement. Il suffit de nommer le fichier cible après la commande unzip : le programme l’extrait sans toucher aux autres éléments de l’archive. Cette fonctionnalité transforme l’archive ZIP en véritable réservoir de fichiers, accessible de manière granulaire.

Cet accès sélectif s’avère particulièrement utile dans les contextes où les archives constituent des dépôts de fichiers variés. Un développeur cherchant une configuration oubliée peut l’extraire sans dérouler l’archive entière. Un administrateur cherchant à vérifier un log spécifique dans une sauvegarde archivée accède instantanément au fichier pertinent. Cette approche rationalise l’accès aux données historiques.

Les noms de fichiers doivent correspondre exactement à ceux listés dans l’archive. Si un fichier se trouve dans un sous-répertoire de l’archive, le chemin complet doit être spécifié. Plusieurs fichiers peuvent être extraits en une seule commande en les énumérant successivement, offrant un moyen efficace de restaurer partiellement l’archive.

- 🎯 Extraire un fichier spécifique : unzip archive.zip document.txt

- 📄 Extraire plusieurs fichiers : unzip archive.zip file1.txt file2.txt file3.txt

- 📂 Extraire d’un sous-répertoire : unzip archive.zip path/to/file.txt

- ✓ Vérifier le chemin exact via unzip -l avant extraction

- ⚠️ Respecter la casse des noms de fichiers

Décompresser plusieurs archives en masse

Lorsque plusieurs archives ZIP requièrent une extraction simultanée, le traitement manuel devientlaborieux. Le wildcard * offre une solution : une seule commande extrait toutes les archives correspondant au motif spécifié. Cette approche s’intègre facilement dans des scripts d’automatisation, accélérant considérablement les tâches répétitives.

La commande unzip « *.zip » traite chaque archive du répertoire courant séquentiellement. Les fichiers extraits se placent dans leurs répertoires respectifs, préservant la structure définie au moment de la compression. Cette forme de traitement en batch réduit les interventions manuelles et minimize les risques d’oubli d’archives.

La combinaison avec l’option -d s’avère puissante : tous les fichiers extraits se placent dans le répertoire cible spécifié. Dans ce cas, une vigilance s’impose concernant les conflits de noms : si plusieurs archives contiennent des fichiers portant les mêmes noms, les fichiers ultérieurs écrasent les précédents. Cette mécanique exige une organisation réfléchie pour éviter les pertes de données involontaires.

| 🔄 Scénario | ⌨️ Commande | 📝 Résultat attendu |

|---|---|---|

| Extraire toutes les archives | unzip « *.zip » | Décompresse tous les fichiers .zip du répertoire |

| Extraire et rediriger | unzip « *.zip » -d /target | Place tous les extraits dans /target |

| Extraire archives spécifiques | unzip archive1.zip archive2.zip | Traite uniquement les deux archives nommées |

| Tester sans extraire | unzip -t « *.zip » | Vérifie l’intégrité de toutes les archives |

Stratégies avancées et bonnes pratiques opérationnelles

Au-delà des opérations basiques, la manipulation efficace de fichiers ZIP en environnement professionnel impose d’adopter des stratégies réfléchies. La méthodologie de compression, les politiques de nommage, la documentation des archives et les tests de restauration constituent autant d’éléments qui transforment la gestion d’archives de simple tâche technique en composante fiable et maintenable d’une infrastructure informatique.

L’expérience acquise en environnements complexes démontre que les petits détails organisationnels préviennent des crises majeures lors de restaurations critiques. Un système documente les stratégies d’archivage, les calendriers de création, et les procédures de vérification. Cette discipline reflète une vision mature de la gestion des ressources informatiques, loin de l’amateurisme des manipulations impromptues.

Vérifier l’intégrité et tester les restaurations

Créer une archive représente une première étape. S’assurer qu’elle peut être restaurée correctement en constitue une impérative. La commande unzip -t valide l’intégrité du fichier ZIP sans modifier quoi que ce soit sur le disque. Cette vérification détecte les corruptions introduites lors de transferts réseau défectueux, de défaillances disque, ou d’altérations accidentelles.

Une archive corrompue découverte au moment de la restauration d’urgence expose l’organisation à des risques majeurs. Les tests systématiques avant archivage définitif et les validations périodiques des archives stockées constituent des investissements mineurs offrant une couverture bien supérieure aux dégâts potentiels. Un cycle régulier de tests—mensuel, trimestriel ou annuel selon les besoins—maintient la confiance dans les systèmes de backup.

La restauration elle-même mérite d’être testée, pas seulement l’intégrité du fichier. Un test complet extrait l’archive vers un emplacement temporaire, vérifie la présence et la structure des fichiers, puis compare les contenus restaurés aux originaux. Cette approche rigoureuse identifie les incompatibilités qui une validation basique manquerait.

- 🔍 Tester l’intégrité : unzip -t archive.zip

- 📋 Lister sans extraire : unzip -l archive.zip | head -n 20

- ⚡ Extraire en dossier temporaire pour validation

- 📊 Comparer les fichiers restaurés avec les originaux

- 📅 Planifier des tests périodiques des archives critiques

Implémenter des conventions de nommage cohérentes

Une archive portant simplement le nom backup.zip crée de l’ambiguïté lors de restaurations ultérieures. Quelles données contient-elle ? De quelle date ? Quelle était sa destination originale ? Des conventions de nommage structurées répondent à ces questions en un coup d’œil. Intégrer la date, le type de contenu et la destination dans le nom transforme le fichier en document auto-documentant.

Un format tel que YYYYMMDD_descriptif_v1.zip offre clarté et cohérence. L’intégration de la date au début facilite le tri chronologique. Le descriptif indique clairement le contenu. La numérotation de version gère les révisions. Cette approche minimaliste prévient confusion et erreurs lors de manipulations critiques.

Dans les environnements automatisés, les conventions de nommage permettent aux scripts d’identifier, d’archiver ou de restaurer les bonnes archives sans intervention manuelle. Un système construit autour de noms prévisibles et structurés gagne en fiabilité et en maintenabilité, facteurs cruciaux pour les opérations informatiques professionnelles.

- 📅 Inclure la date en format YYYYMMDD au début du nom

- 🏷️ Ajouter un descriptif explicite du contenu

- 🔢 Intégrer un numéro de version si pertinent

- 🌍 Inclure l’environnement (prod, staging, dev) si applicable

- ✅ Valider la cohérence des noms dans les scripts d’automatisation

Automatiser la compression et la décompression via scripts

Les tâches répétitives s’automatisent efficacement via des scripts shell. Un script peut compresser quotidiennement des répertoires spécifiques, envoyer les archives vers un serveur de sauvegarde, vérifier leur intégrité, et alerter l’administrateur en cas de problème. Cette approche élimine les manipulations manuelles sources d’erreurs et garantit une exécution fiable selon un calendrier défini.

Les boucles permettent de traiter plusieurs répertoires ou archives. Les conditions testent la réussite des opérations, divergeant le flux selon les résultats. Les fonctions de logging documentent chaque action pour un audit ultérieur. Structurer le script de manière modulaire le rend maintenable et réutilisable sur plusieurs systèmes.

L’intégration avec des outils de scheduler comme cron transforme le script en tâche programmée, exécutée automatiquement sans intervention. Cette synergie entre scripting et scheduling crée une infrastructure de backup robuste et transparent à l’utilisateur final, référence en matière de bonnes pratiques opérationnelles.

| 🔧 Élément du script | 🎯 Fonction | 💡 Avantage |

|---|---|---|

| Boucles for/while | Traitement répété d’éléments | Compresser multiples répertoires |

| Conditions if/else | Gestion des scénarios variés | Réagir aux erreurs ou succès |

| Variables et logging | Traçabilité et documentation | Audit des opérations effectuées |

| Cron ou systemd | Exécution programmée | Automatisation sans intervention |

| Notifications et alertes | Feedback sur exécution | Détection rapide des anomalies |

Gérer les archives volumineuses et fragmentées

Certaines archives dépassent les limitations des systèmes de fichiers ou des transferts réseau. Bien que ZIP ne propose pas nativement la fragmentation, des contournements existent. La compression en plusieurs archives séquentielles, avec un manifest documentant les dépendances, divise les données en portions gérables. Chaque fragment reste indépendant, facilitant les transferts ou les stockages sur des supports limités.

Des outils comme zip -s permettent de créer des archives fractionnées, génétrant automatiquement archive.z01, archive.z02, etc. La décompression avec unzip sur le fichier principal fusionne automatiquement les fragments. Cette approche conserve la transparence pour l’utilisateur final tout en contournant les limitations techniques.

Bien que ZIP gère techniquement les archives multi-segments, les tests préalables demeurent essentiels. La perte d’un fragment rend l’archive entière inutilisable. La redondance et les sauvegardes distribuées sur plusieurs emplacements géographiques offrent une couche de protection contre ces scénarios cataclysmiques.

Cas d’usage professionnels et scénarios concretes d’implémentation

La théorie sans application concrète demeure abstraite. Examiner les cas d’usage réels éclaire les considérations pratiques qui distinguent un administrateur novice d’un professionnel expérimenté. Les scénarios qui suivent reflètent des situations rencontrées régulièrement en environnements de production, offrant perspectives et solutions éprouvées.

Sauvegarde et archivage des environnements de production

Une application critique génère quotidiennement des données : bases de données, fichiers de configuration, journaux d’activité. Une stratégie de backup robuste compresse ces données régulièrement. Un script cron lance chaque nuit la compression du répertoire applicatif, crée une archive datée, la transfère vers un serveur de sauvegarde distant, vérifie son intégrité, puis supprime la version locale pour économiser l’espace disque.

Cette approche applique plusieurs principes clés : la compression réduit les coûts de bande passante et de stockage. La datation précise du nom d’archive facilite les restaurations point-in-time. La vérification d’intégrité prévient les découvertes désagréables lors des restaurations réelles. La suppression des données locales après sauvegarde optimise l’espace disque du serveur de production, liberté de ressources pour les opérations critiques.

Les tests mensuels de restauration complète simulent les scénarios de désastre. Un administrateur extrait une archive de plusieurs mois en arrière, valide sa structure et son contenu, confirmant que le processus de backup n’a pas dérivé au fil du temps. Ces drills maintiennent la crédibilité du système de backup et détectent les dégradations avant qu’elles ne causent de vraies pertes.

- 🕐 Script cron : compression quotidienne à minuit

- 📤 Transfert automatique vers serveur de backup

- ✅ Vérification d’intégrité post-transfert

- 🧹 Suppression des données locales après sauvegarde validée

- 🧪 Tests mensuels de restauration complète

Distribution de projets logiciels et livrables

Un projet logiciel doit être distribué à des clients ou partenaires externes. L’empaquetage d’une archive ZIP contenant le code source, la documentation, les fichiers de configuration modèle et une licence centralise tout dans un livrables unique et facilement transportable. Le contrôle de version du contenu se fait via numérotation (v1.0, v1.1, v2.0) intégrée au nom de l’archive.

La sécurité intervient : si l’archive contient des données sensibles ou du code propriétaire, le chiffrement par mot de passe s’impose. Le mot de passe est transmis via canal sécurisé séparé du fichier ZIP, garantissant qu’un interception du transport ne compromet pas la donnée. Cette séparation des secrets et des données s’inscrit dans les bonnes pratiques de sécurité informatique.

La documentation embarquée—fichier README à la racine de l’archive—guide le destinataire. Elle explique la structure des répertoires, les prérequis d’installation, les instructions de déploiement. Cette auto-documentation améliore l’expérience du destinataire et réduit les demandes de support frustrantes.

- 📦 Inclure code source, docs, configs et licences

- 🏷️ Nommer explicitement : projetnom-v2.0.zip

- 🔐 Chiffrer si données sensibles

- 📖 Ajouter fichier README explicatif

- 🔄 Tester l’extraction sur machine vierge

Migration entre serveurs et outils de déploiement

Une entreprise doit migrer un site web d’un serveur legacy vers une infrastructure cloud moderne. La compression du répertoire web en archive ZIP facilite le transfert sur des connexions réseau potentiellement limitées. Une seule transmission compressée remplace des dizaines de transferts de fichiers individuels, accélérant la migration.

Une fois l’archive reçue sur le serveur cloud, la décompression restitue la structure originale instantanément. Si les droits de fichiers ou propriétaires diffèrent entre les systèmes, des scripts post-décompression les ajustent. Cette approche dissocie les phases de transfert et de reconfiguration, structurant la migration en étapes gérables.

L’intégration avec des outils de déploiement—Docker, Kubernetes, Ansible—bénéficie des archives ZIP. Une image Docker peut être construire à partir d’une archive extraite, encapsulant la configuration et les dépendances. Les playbooks Ansible automatisent l’extraction sur plusieurs serveurs cibles, synchronisant les déploiements sans gestion manuelle.

| 📌 Étape | ⚙️ Opération | 🎯 Outil/Commande |

|---|---|---|

| 1. Compression | Empaqueter le site web | zip -r site.zip ./website/ |

| 2. Transfert | Envoyer vers cloud | scp site.zip user@cloudserver:/tmp/ |

| 3. Décompression | Extraire sur serveur cible | unzip /tmp/site.zip -d /var/www/ |

| 4. Reconfiguration | Ajuster droits et permissions | chmod -R 755 /var/www/website/ |

| 5. Vérification | Tester la fonctionnalité | Tests intégration et smoke tests |

L’expertise en compression et décompression de fichiers ZIP sous Linux transcende les simples manipulations de données compressées. Elle s’inscrit dans une vision globale de l’administration informatique, où chaque outil contribue à une infrastructure fiable, efficiente et facilement maintenable. Les commandes zip et unzip, malgré leur apparence simple, offrent une puissance considérable lorsqu’elles sont appliquées avec méthode et compréhension contextuelle. Un administrateur système ou développeur maîtrisant ces outils dispose d’une capacité opérationnelle remarquablement amplifiée dans la gestion quotidienne de l’archivage, du backup et du déploiement de systèmes complexes.