Un switch réseau représente bien plus qu’un simple équipement de connexion : c’est le cœur battant de tout réseau informatique moderne, responsable d’acheminer intelligemment les données entre des dizaines ou des centaines d’appareils. Contrairement à ses prédécesseurs rudimentaires, le switch a révolutionné la façon dont les données circulent en créant des circuits virtuels dédiés plutôt que de diffuser indiscriminément le signal à tous les ports. Cette distinction fondamentale fait toute la différence entre un réseau fluide et performant et une infrastructure paralysée par les collisions de données.

Qu’est-ce qu’un switch réseau et quel est son rôle exact en infrastructure informatique ?

Un switch réseau est un équipement qui connecte plusieurs appareils dans un réseau local et transmet les données de façon ciblée grâce à l’adresse MAC de chaque appareil, assurant ainsi une communication efficace, sans collision et simultanée entre de nombreux équipements.

Un switch réseau, aussi appelé commutateur, est un dispositif qui connecte plusieurs équipements au sein d’un réseau local (LAN) en gérant intelligemment la transmission des données entre eux. À la différence d’un routeur qui opère à un niveau différent du modèle OSI, le switch fonctionne en couche 2, celle de la liaison de données, ce qui lui permet de prendre des décisions d’acheminement basées sur l’adressage MAC des appareils.

Le switch joue un rôle de concentrateur sophistiqué : il reçoit des trames de données arrivant sur l’un de ses ports et les commute intelligemment vers le port de destination approprié. Imaginez-le comme un standardiste téléphonique d’autrefois qui, au lieu de brancher un câble pour chaque communication, saurait automatiquement où envoyer chaque appel sans intervention manuelle. Le switch effectue exactement ce travail, mais en quelques millièmes de seconde et pour des milliers de communications simultanées.

Son rôle central se matérialise par plusieurs responsabilités clés : d’abord, il établit et maintient une table CAM (Content Addressable Memory) qui cartographie chaque adresse MAC aux ports physiques correspondants. Ensuite, il filtre et achemine les trames exclusivement vers leur destination, éliminant ainsi les collisions qui paralysaient les anciens hubs. Enfin, il gère le trafic de manière efficace, permettant plusieurs communications simultanées sans ralentissement global du réseau.

Comment s’est opérée la transition entre les concentrateurs et les switchs modernes ?

Pour comprendre l’importance du switch contemporain, il faut connaître son ancêtre : le concentrateur ou hub. Ce dispositif, opérant en couche 1 (couche physique), fonctionnait comme une simple multiprise réseau. Chaque donnée entrante était instantanément rediffusée sur tous les autres ports, ce qui créait des situations chaotiques lorsque plusieurs appareils tentaient de communiquer simultanément.

Ces collisions de données représentaient une véritable plaie pour les réseaux anciens. Des mécanismes de détection comme CSMA/CD (Carrier Sense Multiple Access with Collision Detection) tentaient de gérer le problème, mais de manière réactive et inefficace. Les administrateurs réseau devaient même surveiller des LEDs spéciales signalant les collisions, comme des voyants d’alerte permanente. De plus, ces réseaux fonctionnaient en mode half-duplex (semi-duplex), interdisant à un appareil d’envoyer et de recevoir des données simultanément, amplifiant encore les goulots d’étranglement.

Le switch a marqué une rupture technologique majeure en apportant l’intelligence à la couche 2. Plutôt que de diffuser aveuglément, il crée des circuits virtuels entre deux points spécifiques, isolant chaque communication dans son propre canal. Cette approche a été si révolutionnaire qu’elle a rapidement rendu les hubs obsolètes, bien que quelques exemplaires subsistent dans des environnements très anciens où ils causent parfois des dysfonctionnements spectaculaires s’ils sont malencontreusement réactivés.

Comment fonctionne précisément le mécanisme de commutation au sein d’un switch ?

Le mécanisme de commutation du switch s’appuie sur l’apprentissage et l’association des adresses MAC aux ports, ce qui permet d’acheminer chaque trame uniquement vers le port de destination, évitant ainsi la diffusion inutile et réduisant les collisions sur le réseau.

Le fonctionnement du switch repose sur un principe simple mais efficace : la lecture et l’utilisation de l’adresse MAC source et destination contenue dans chaque trame de données. Lorsqu’un appareil envoie des données à travers le réseau, ces informations d’identification physique guident le switch dans sa prise de décision d’acheminement.

Concrètement, imagine un PC A connecté au port 1 d’un switch qui souhaite communiquer avec un PC B branché au port 10. Le PC A prépare sa trame de données, y inscrit ses adresses MAC source et destination, puis l’envoie. Cette trame arrive au switch sur le port 1. À cet instant, le switch effectue plusieurs actions simultanées : il lit l’adresse MAC source (celle du PC A) et l’ajoute à sa table CAM, l’associant au port 1 pour mémoriser la localisation de cet appareil.

Cependant, si le switch ne connaît pas encore l’emplacement du PC B (destination), il ne dispose pas de l’information nécessaire pour commuter précisément la trame. À ce moment du cycle, il se comporte temporairement comme un hub : il envoie la trame sur tous les ports sauf celui d’arrivée (port 1). Seul le PC B reconnaît sa propre adresse MAC dans l’en-tête et répond. Lorsque cette réponse entre au port 10, le switch enregistre l’adresse MAC du PC B et l’associe au port 10 dans sa table CAM.

Le fonctionnement de la table CAM : mémoire du switch

La table CAM (Content Addressable Memory) ou table MAC constitue la mémoire vive du switch, son système nerveux qui lui permet de « savoir » où sont localisés tous les appareils connectés. Cette table est dynamique et se construit progressivement au fur et à mesure que le switch observe le trafic réseau. Chaque entrée associe une adresse MAC spécifique au numéro du port par lequel cet appareil communique.

Une caractéristique essentielle de cette table est sa temporalité. Les entrées ne sont pas permanentes : elles possèdent une durée de vie limitée qui varie selon le fabricant du switch, généralement entre 5 et 15 minutes. Si un appareil ne génère aucun trafic durant cette période, son entrée expire et disparaît de la table. De plus, chaque redémarrage du switch réinitialise complètement la table CAM, forçant le processus d’apprentissage à recommencer de zéro.

Lorsqu’un PC A initialement branché au port 1 se déconnecte puis se reconnecte au port 2, le switch met à jour automatiquement sa table CAM à la réception de la première trame en provenance de ce nouvel emplacement. Ce système adaptatif permet aux switchs de fonctionner correctement même dans des environnements où les appareils se déplacent ou se reconnectent fréquemment. Après que le switch ait construit sa table CAM et identifié où se trouve chaque destination, il peut exécuter une véritable commutation : acheminer les trames uniquement vers le port pertinent, sans les diffuser inutilement.

La technique du cut-through et ses implications

Le switch dispose de plusieurs méthodes pour commuter les trames, la plus efficace et répandue étant le cut-through. Cette technique révolutionne la perception traditionnelle de la couche 2 en accelerant dramatiquement le traitement des données. Plutôt que d’attendre la réception complète d’une trame avant de commencer à l’acheminer, le switch can start forwarding dès qu’il a lu l’adresse MAC de destination dans les premiers octets de la trame.

Ce fonctionnement au cut-through réduit considérablement la latence, le délai entre l’émission et la réception. Dès que les 14 premiers octets d’une trame arrivent (contenant les adresses MAC), le switch peut consulter sa table CAM et commencer immédiatement à envoyer la trame vers le port de destination, tout en continuant de recevoir le reste des données. Cette approche ultra-réactive distingue les équipements haute performance des solutions plus anciennes.

| 🔄 Méthode de commutation | 📍 Point de décision | ⏱️ Latence | ✓ Avantage principal |

|---|---|---|---|

| Cut-through | Après les 14 premiers octets | Minimale | Rapidité extrême |

| Store-and-forward | Après réception complète | Plus élevée | Vérification complète de la trame |

| Fragment-free | Après 64 premiers octets | Intermédiaire | Équilibre entre vitesse et vérification |

Pour vérifier si un switch fonctionne en mode cut-through ou store-and-forward, consultez sa documentation ou observez la latence lors de tests de transfert de fichiers volumineux : une latence très faible peut indiquer l’utilisation du mode cut-through.

Quels sont les éléments clés de la couche 2 qui permettent au switch de fonctionner ?

La couche 2 repose sur l’adressage MAC, la segmentation en trames et le protocole Ethernet, permettant au switch d’identifier, d’acheminer et de vérifier les données entre les appareils connectés, tout en assurant la détection et l’isolation des erreurs de transmission.

La couche 2 du modèle OSI, aussi nommée couche liaison de données, constitue l’environnement opérationnel fondamental du switch. C’est à ce niveau que s’établissent les règles régissant comment les données sont physiquement transmises et comment les appareils se « reconnaissent » mutuellement sur le réseau. Le protocole prépondérant dans cette couche pour les réseaux filaires est Ethernet, un standard universel qui a perdura depuis les années 1980 en s’adaptant constamment aux besoins croissants de bande passante.

La couche 2 découpe les flux de données en unités gérables appelées trames. Chaque trame possède une structure bien définie comportant un en-tête, les données utiles et une queue de vérification. L’en-tête contient des informations critiques pour l’acheminement : l’adresse MAC de destination (placée en premier pour accélérer le traitement), l’adresse MAC source, et un champ EtherType indiquant le type de protocole encapsulé à l’intérieur.

Structure détaillée d’une trame Ethernet

Une trame Ethernet débute par un préambule, une séquence de bits servant à synchroniser l’équipement récepteur avec le flux entrant. Suit le SFD (Start Frame Delimiter), un marqueur qui signale le début effectif des données importantes. C’est un peu comme un « clignotant » routier indiquant aux appareils que l’information pertinente commence.

Immédiatement après arrive l’adresse MAC de destination, identifiant l’appareil cible. Cette position privilégiée en début de trame permet au switch de décider presque instantanément si la trame lui est destinée ou doit être acheminée ailleurs. L’adresse MAC source suit, permettant au switch de mettre à jour sa table CAM et à l’appareil destinataire de connaître l’émetteur du message.

Le champ EtherType est déterminant : il indique quel type de données se trouve encapsulé dans la trame, permettant à la couche 2 de communiquer avec les couches supérieures du modèle OSI. Les données elles-mêmes constituent le payload, le véritable contenu du message, limité à 1500 octets maximum (la MTU, Maximum Transmission Unit). Enfin, chaque trame se termine par un FCS (Frame Check Sequence), une vérification de contrôle de flux qui détecte les modifications accidentelles des bits pendant le transport.

Le FCS et la détection d’erreurs

Le FCS représente un mécanisme de sécurité au sens purement technique du terme, non cryptographique. Il utilise un calcul mathématique pour vérifier qu’aucun bit n’a changé de valeur (passant de 0 à 1 ou inversement) durant son trajet à travers les câbles. Les câbles en cuivre subissent constamment des interférences électromagnétiques provenant de sources variées : néons, fours à micro-ondes, smartphones, signaux wifi environnants.

Imaginez l’analogie d’une lettre papier où vous écriveriez en bas « Cette lettre contient 23 ‘a’, 15 ‘e’ et 31 ‘i’ ». Le destinataire peut rapidement vérifier votre calcul ; s’il dénombre 24 ‘a’, il sait quelque chose s’est déroulé incorrectement en transit. C’est précisément le concept du FCS, sauf que le calcul opère sur des bits plutôt que des caractères.

Lorsqu’une trame arrive avec un FCS invalide, elle est simplement abandonnée (mise à la poubelle) sans que l’appareil source en soit informé. La couche 2 n’envoie jamais de notification d’erreur ni ne demande de retransmission ; cette responsabilité incombe aux couches supérieures. C’est une distinction architecturale majeure du modèle OSI : chaque couche remplit sa fonction définie, sans déborder sur les responsabilités des autres niveaux.

Le full-duplex sur un switch permet à chaque appareil de communiquer simultanément dans les deux sens, doublant ainsi la bande passante disponible par rapport au mode half-duplex utilisé dans les anciens hubs.

Quel est l’impact du switch sur la performance et la structure d’un réseau informatique ?

L’utilisation de switchs augmente la performance réseau en permettant plusieurs communications simultanées sans collision, améliore la sécurité par l’isolation du trafic et optimise la bande passante grâce au mode full-duplex et à la segmentation des domaines de collision.

L’introduction du switch a fondamentalement transformé la topologie réseau et les capacités de gestion du trafic. Là où les hubs créaient un environnement chaotique de collisions, les switchs établissent un ordre sophistiqué permettant à plusieurs communications de s’effectuer simultanément sans interférence. Cette capacité à gérer des connexions parallèles multiplie effectivement la bande passante disponible.

Imaginons un switch avec 24 ports, chacun capable de transmettre à 1 Gbps. Avec un hub, l’ensemble des appareils partageraient ces 1 Gbps, créant un goulot d’étranglement où chaque appareil reçoit une fraction minuscule. Avec un switch, plusieurs appareils peuvent communiquer simultanément à pleine vitesse, puisque chaque communication bénéficie de son propre circuit virtuel. Un ordinateur du port 5 peut envoyer 1 Gbps au port 8, tandis qu’un autre du port 12 envoie 1 Gbps au port 15, sans conflit ni ralentissement mutuel.

La segmentation du réseau et la réduction des domaines de collision

Les switchs permettent de segmenter un grand réseau en plusieurs segments de réseau plus petits et isolés. Cette segmentation réduit dramatiquement le nombre d’appareils partageant le même espace de communication. Chaque port du switch constitue son propre domaine de collision isolé, contrairement aux hubs où tous les ports formaient un unique domaine partagé.

Une collision, rappelons-le, survient quand deux appareils tentent de communiquer exactement au même moment sur le même support physique. Avec un hub, 48 appareils sur 48 ports pouvaient entrer en collision simultanée, ralentissant catastrophiquement le réseau. Avec un switch, chaque port fonctionne indépendamment, éliminant pratiquement les collisions internes (elles peuvent survenir entre un appareil et le switch, mais le switch les gère grâce au full-duplex moderne).

Cette segmentation offre également des bénéfices en matière de sécurité réseau. Un appareil ne peut observer que le trafic qui le concerne directement, sans accès aux communications entre les autres appareils. Cet isolement a des implications majeures dans les environnements d’entreprise où la confidentialité et la cloisonnement des données demeurent des impératifs stratégiques.

Évolution de la bande passante et passage au full-duplex

Les switchs modernes fonctionnent en mode full-duplex (duplex intégral), ce qui signifie qu’un appareil peut envoyer ET recevoir des données simultanément sur le même port. Cette capacité double effectivement la bande passante utilisable pour chaque connexion. Là où un hub en mode half-duplex utilisait 1 Gbps de manière partagée et unidirectionnelle à la fois, un switch en full-duplex permet à un appareil d’utiliser 1 Gbps pour l’émission et 1 Gbps pour la réception dans le même intervalle de temps.

Cette évolution s’accompagne d’une augmentation progressive des débits disponibles. Les switchs gigabit (1 Gbps par port) se sont généralisés depuis les années 2000, et on observe désormais l’émergence de switchs 10 Gbps, voire 40 Gbps sur certains ports destinés à l’interconnexion d’équipements critiques. Les architectures réseau modernes exploitent cette progression pour supporter des volumes de données exponentiellement croissants.

L’importance du dimensionnement pour garantir la performance

Bien que le switch améliore radicalement la performance par rapport aux hubs, le dimensionnement reste critique. Un switch de qualité médiocre ayant une capacité d’acheminement (backplane) insuffisante peut devenir un goulot d’étranglement. La capacité d’acheminement (switching fabric capacity) détermine la quantité totale de données que le switch peut traiter simultanément toutes directions confondues.

- 🔌 Évaluer le nombre d’appareils à connecter et leur bande passante moyenne

- 📊 Vérifier la capacité d’acheminement du switch pour supporter le pic théorique de trafic

- ⚙️ Considérer la redondance et les liens montants (uplinks) vers d’autres switchs ou routeurs

- 🔒 Examiner les fonctionnalités de gestion de la qualité de service (QoS) pour prioriser le trafic critique

- 🛡️ Évaluer les capacités de sécurité du switch comme le contrôle d’accès ou la protection contre les tempêtes de broadcast

Pour éviter les tempêtes de broadcast causées par des boucles réseau, activez systématiquement le protocole STP (Spanning Tree Protocol) sur tous vos switchs, surtout dans les infrastructures complexes.

Quels défis pratiques et limitations rencontre-t-on lors du déploiement des switchs ?

Les défis rencontrés incluent la gestion des boucles réseau, le débordement de la table CAM, la qualité du câblage et la sécurité des ports ; chacun de ces points peut entraîner des dégradations de performance, des interruptions de service ou des failles de sécurité si mal maîtrisés.

Malgré ses avantages manifestes, l’intégration d’un switch réseau dans une infrastructure existante présente des défis techniques et opérationnels réels. Ces enjeux proviennent souvent de configurations inadéquates, d’incompatibilités matérielles ou d’une compréhension insuffisante des phénomènes qui se produisent à la couche 2.

L’une des problématiques récurrentes concerne les boucles de réseau, qui surviennent quand deux switchs ou plus sont connectés de manière redondante créant un circuit fermé. Sans protocole de prévention approprié, les trames peuvent circuler indéfiniment dans cette boucle, générant une « tempête de broadcast » qui paralyse complètement le réseau. Le protocole STP (Spanning Tree Protocol) a été développé pour gérer ce phénomène en désactivant sélectivement certains liens redondants, mais sa configuration demande une expertise solide.

Gestion des tables CAM et débordement de mémoire

Un autre défi moins visible mais tout aussi impactant concerne l’overflow CAM : le débordement de la table de contenu. Un switch possède une capacité maximale de stockage d’adresses MAC. Un réseau mal planifié connectant des centaines d’appareils mobiles (téléphones, tablettes, ordinateurs portables) peut saturer cette table.

Lorsque la table CAM atteint sa limite, le switch bascule en mode « fail-open » : il commence à envoyer les trames dont l’adresse de destination n’est pas encore dans la table sur tous les ports (comme un hub), diminuant drastiquement la performance. Cette condition, rare dans les petits réseaux, devient un véritable problème dans les environnements densément peuplés où des appareils se connectent et déconnectent constamment.

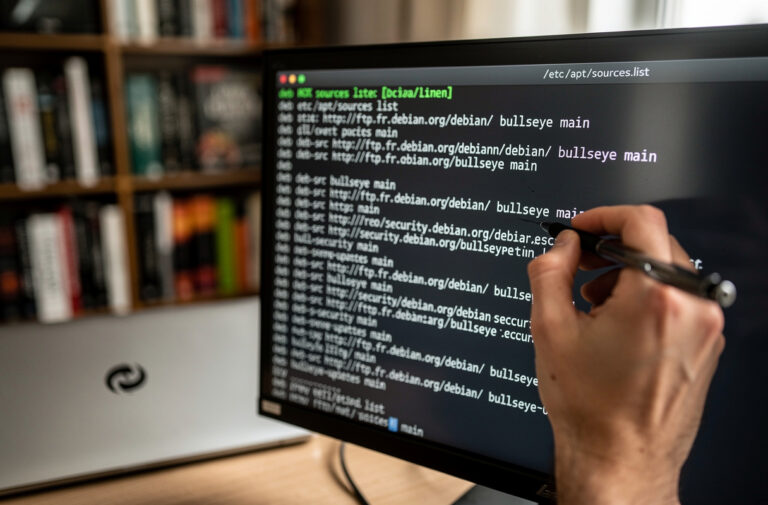

Problèmes de câblage et de standards Ethernet

La qualité du câblage Ethernet conditionne directement les performances du switch. Des câbles mal terminés, dégradés ou mal catégorisés (utiliser du Cat5 pour du gigabit par exemple) entraînent des retransmissions de trames, des micro-coupures et une dégradation significative de la bande passante réelle. Un administrateur réseau expérimenté consacre beaucoup de temps à valider la qualité physique du câblage avec des appareils de test appropriés.

De plus, l’interopérabilité entre matériels de fabricants différents peut créer des complications subtiles. Bien qu’Ethernet soit un standard universel, certaines implémentations propriétaires ou des versions anciennes de firmware peuvent ne pas coexister harmonieusement. Tester les équipements dans l’environnement cible avant un déploiement complet demeure une pratique indispensable.

| 🚨 Défi courant | 🔍 Symptôme observé | 💡 Solution typique |

|---|---|---|

| Boucle réseau | Réseau complètement saturé, ping impossible | Activer STP, vérifier topologie physique |

| Débordement CAM | Performance dégradée, latence variable | Augmenter la capacité, segmenter le réseau |

| Câblage dégradé | Paquets perdus, taux d’erreur élevé | Remplacer câbles, vérifier connecteurs |

| Congestion de port | Un port spécifique ralentit tout | Ajouter uplinks, équilibrer charge |

Sécurité du switch et vulnérabilités couches 2

Souvent négligée, la sécurité au niveau du switch présente des risques concrets. Des attaques comme le MAC flooding (saturation de la table CAM avec de fausses adresses) ou le VLAN hopping (tentative d’accès à des segments isolés) exploitent précisément la façon dont le switch fonctionne. Sans configurations de sécurité appropriées (port security, authentification 802.1X, isolement VLAN), un attaquant physiquement connecté au réseau peut compromettre la confidentialité des données.

La configuration par défaut de nombreux switchs est intentionnellement permissive pour faciliter le déploiement initial, mais elle laisse le système extrêmement vulnérable. Les bonnes pratiques incluent la limitation du nombre d’adresses MAC par port, la désactivation des ports inutilisés et la mise en place d’une architecture VLAN rigoureusement planifiée. Ces mesures augmentent la complexité d’administration mais élèvent significativement le niveau de sécurité du réseau local.

Le switch occupe une place centrale dans l’infrastructure réseau contemporaine, orchestrant des milliards de communications quotidiennes entre appareils. Comprendre son fonctionnement interne, ses capacités et ses limitations permet aux professionnels informatiques de concevoir des réseaux robustes, performants et sécurisés adaptés aux exigences réelles des organisations.

Le rôle du switch réseau dans une topologie informatique repose sur sa capacité à établir des circuits virtuels dédiés entre appareils

Le rôle du switch réseau dans une topologie informatique repose sur sa capacité à établir des circuits virtuels dédiés entre appareils